10分钟,被诈骗分子通过AI换脸化身“好友”,骗走430万元――这是近日“平安包头”微信公众号公布的一位受害者的经历。相关话题登上热搜,引发网友关注。

AI换脸,即通过人工智能技术,将视频中某个人物的脸轻易替换成另一个人的脸。利用AI换脸,普通人可以感受娱乐氛围、影视作品能获得创意效果。但是,当AI换脸技术被不法分子利用,也带了诈骗等危害……

AI换脸的应用边界在哪里?普通人应该如何防范AI换脸带来的风险?

AI换脸诈骗不时发生

有人10分钟被骗430万元

你也许已经看过了包头市公安局通过“平安包头”微信公众号公布的这起电信诈骗案例:

来自福建的郭先生是一家科技公司法人代表。今年4月,他的好友突然通过微信视频联系他,称自己在外地投标,需要430万元保证金,想借用郭先生公司的账户走一下账。

基于对好友的信任,加上视频聊天中“核实”了身份,10分钟后,郭先生分两笔把430万元给对方打了过去。而后,郭先生拨打好友电话,对方说没有这回事,他这才意识到竟然遇上了“高端”骗局,对方通过智能AI换脸技术,佯装成好友对他实施了诈骗。

“从头到尾都没有和我提借钱的事情,就说会先把钱给我打过来,再让我给他朋友账户转过去,而且当时是给我打了视频的,我在视频中也确认了面孔和声音,所以才放松了戒备。”郭先生说。

事实上,郭先生的遭遇并非单一案例,近年来,利用AI换脸、AI拟声等技术进行的诈骗不时发生。

据公安部网安局公布的消息,2020年12月,某公司财务小王接到领导电话,要求立刻给供应商转款2万元。由于老板的口音十分逼真,小王信以为真,在1小时内转款完成,后发现被骗。

浙江温州市公安局曾发布案例,2021年拱宸桥派出所接到报警,受害人小陈与女网友视频聊天后,被对利用AI换脸技术,将小陈视频中的面部合成到不雅视频中,借此对其实施勒索。

不法分子如何利用AI换脸诈骗?北京师范大学法学院博士生导师、中国互联网协会研究中心副主任吴沈括表示,在技术上,这类诈骗往往通过非法获取他人个人数据,以及运用各种黑灰软件来替换数据信息来实现。

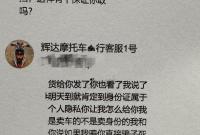

浙江金道律师事务所律师夏文忠在接受潮新闻记者采访时,分享了曾代理过的一个案例细节:当诈骗分子加上受害人微信后,只需一个电脑插件就可以在社交软件聊天时篡改讲话声音,甚至形象,“受害人听到的柔美女声,实际上来自一个五大三粗的男子。”

“这类案件中,不法分子利用AI换脸,伪造事实、隐瞒真相,使被害人陷入错误的认识,从而交付财物,涉嫌诈骗罪,需要加倍警惕。”夏文忠表示。

AI换脸并不新鲜

普通人娱乐、主播带货已经有之

AI换脸早已不是新鲜事,除了变“熟人脸”实施诈骗,已应用至多个领域。

比如,在日常生活中,不少网友体验过娱乐性的AI换脸。早在2019年,一款名为“ZAO”的AI换脸软件就曾风靡网络,只需上传一张照片就能让普通人成为影视剧的男女主角,出演经典电影片段、甚至跟偶像飙戏,受到众多网友的体验追捧。不过,短时间内,这款软件就因侵犯版权、侵害隐私、危害数据安全等问题,被下架处理。

而当前,在手机应用商店搜索关键词,依然有许多和AI换脸有关的app。记者随意下载了两款app,都只需上传一张正脸照片,便可将妆发造型姣好的视频或图片模板替换为自己的脸庞。

AI换脸也被应用于影视行业。在《三千鸦杀》《了不起的儿科医生》《长安十二时辰》等影视作品中,都因为原演员问题,部分角色用到了AI换脸技术。

吴沈括表示,在内容产业上,AI换脸有它的优势和价值,比如,丰富了人们的文化娱乐生活等,但同时它的风险不容忽视,这些风险既包括对于他人个人数据的非法使用、非法处理,也包括传播虚假信息、诈骗或者其他违法犯罪活动。

在风险层面,今年4月,拥有148万多粉丝的网络博主@Caro赖赖通过微博公开发文,曝光了自己的脸被盗用的经历。不法分子用她的脸,通过AI换脸制作不雅视频并从中牟利。当她追根究底,却发现分发视频的账号都是海外IP,溯源困难。

今年5月,有媒体报道,当不少网友点开直播间,发现正在卖货的竟是“杨幂”“迪丽热巴”等一些当红女星。但仔细观察后发现,这些带货的“明星”,实际上只是使用了AI实时换脸的普通主播。

“无论是普通人用APP一键换脸,还是普通主播用明星脸带货,甚至不法分子盗用网红脸制作不雅视频,AI换脸技术的部分滥用很有可能会侵犯到他人的肖像权、名誉权,甚至可能构成刑事犯罪。”因此,夏文忠表示,对于AI换脸风险的管控不可忽视。

普通人如何应对AI换脸风险?

律师、专家提醒:提高警惕,必要时可诉诸法律

面对AI换脸带来的诈骗等风险,应该怎么防?夏文忠认为,加强监管、健全立法是重要手段。

目前,我国已出台的《民法典》第1019条明确规定,任何组织或者个人不得以丑化、污损,或者利用信息技术手段伪造等方式侵害他人的肖像权。

去年12月,国家网信办、工信部、公安部联合发布《互联网信息服务深度合成管理规定》,对人脸生成、人脸替换等都有明确约束。其中明确,深度合成服务提供者和技术支持者提供人脸、人声等生物识别信息编辑功能的,应当提示深度合成服务使用者依法告知被编辑的个人,并取得其单独同意。

今年4月11日,国家网信办也出手,为生成式人工智能“立规矩”,公布了《生成式人工智能服务管理办法(征求意见稿)》,其中提到,AI内容必须真实准确,还明确提到,禁止非法获取、披露、利用个人信息和隐私、商业秘密。

夏文忠还认为,除此之外,各网络平台对于AI换脸的应用也应当担负起责任。“目前,推出AI换脸功能的平台以及允许AI换脸相关内容传播的平台,都应该加强审核,以避免AI技术被不法分子利用,以及避免损害公民肖像、名誉权等。”

此外,对普通个人而言,夏文忠也建议,无论是否遭遇AI换脸诈骗,现实生活中,只要涉及汇款转账,就都应该提高警惕,通过多个渠道核实对方身份与信息。此外,如果遇到被AI换脸损害了肖像、名誉权等,也要勇于站出来,让对方以及平台删除相关内容并赔礼道歉,必要时也可以寻求警方帮助,甚至进行诉讼。

针对个人而言,吴沈括也建议,要加强数字素养,提高自身使用数字工具的安全意识和安全能力;同时,增强自我保护意识,防止个人信息的泄露;此外,也要提升法治意识,对诈骗等违法违规行为保持警惕,加强维权能力和意识。

编辑: 魏涛纠错:171964650@qq.com