�������Ƿ��������ľ���������������AI��������Ѹ�ٸ�������רҵ�������Ľ�𣬿�һ�����ã����е���ʵ�����ݡ����ۣ�Ҫô��Ϣ��λ��Ҫô�������С�

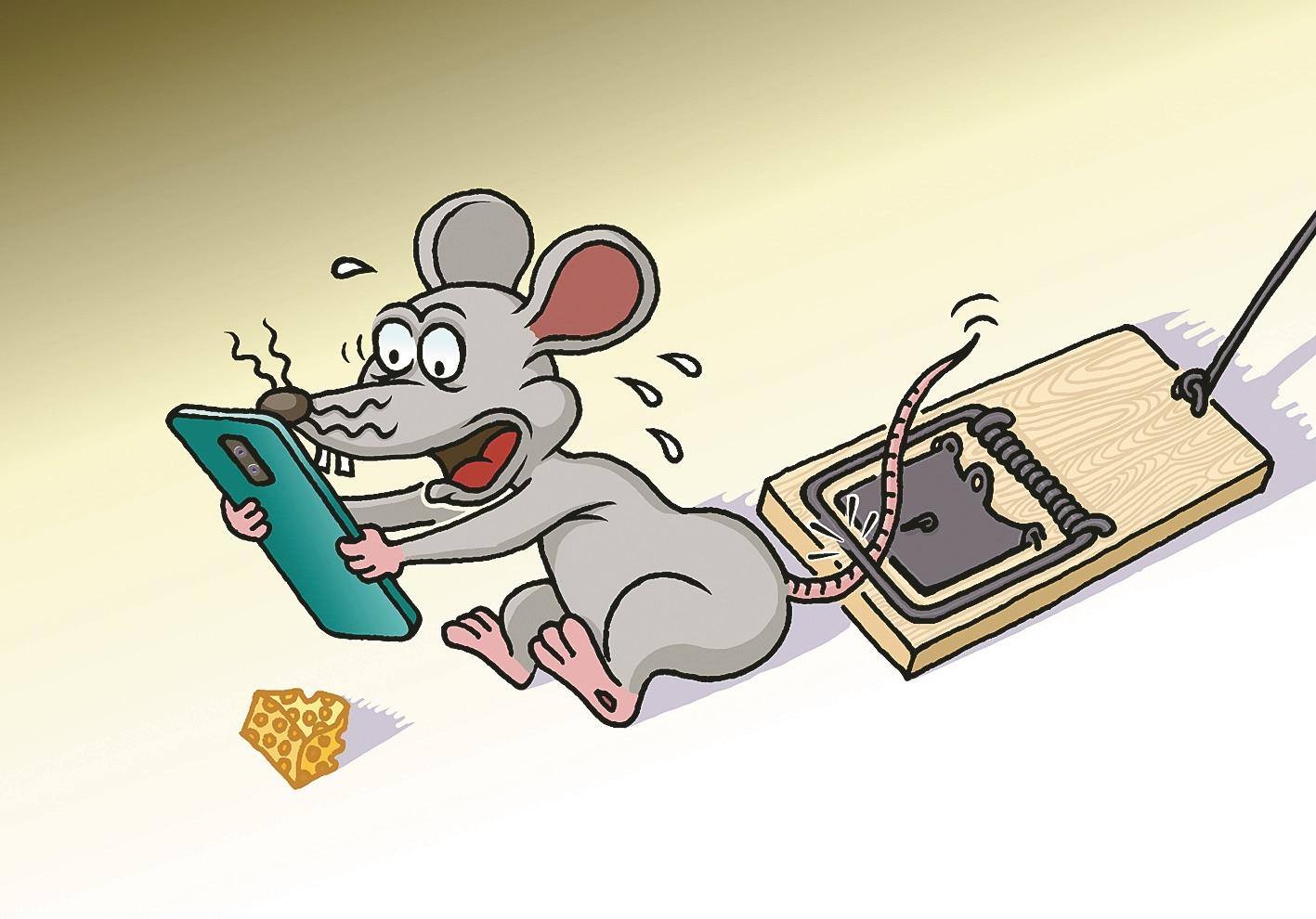

����AIһ��������“��˵�˵�”������“AI�þ�”�ĵ��ͱ��֡�

����������ʽ�˹����ܼ������ٷ�չ���ռ�֮�ʣ�“AI�þ�”ƵƵ�������������참�����鹹���֡���ͼ�������г��ֲ�����Ԫ�صȣ�����ʹ������Ϣ��“�Ź����”������ҽ�ơ����ڡ�������רҵ��������������֪��������ʵ�ķ�����������ս����Ϊ������������η���Դ��

���������Ȼ�����ճ������“AI�þ�”�����Ӧ�ԣ�AI��������˭�����������

��������AI�Բ�����

����������Ϣ���ش����⡢�����칫����������Ƶ������������죬�۲쵱�����������ճ���AIԽ��Խ��Ϊ���ɻ�ȱ�IJ��֡�

�����ݡ���57���й��������緢չ״��ͳ�Ʊ��桷������2025��12�µף��ҹ�����748������ʽ�˹����ܷ�����ɱ������û���ģ�ﵽ6.02���ˣ�ռȫ���˿ڵ�42.8%������ζ�ţ�ÿ�������о���һ��ʹ�ù�AI��

����AI����ǧ�а�ҵ֮�ʣ�Ҳ������һ��“����”——AI�þ�����ǰ���廪��ѧ�����봫��ѧԺ��ý���о����ĺ��˹�����ѧԺ���г��϶�����Ŵ�ģ�ͽ�����ʵ�Իþ����⣬���ֻþ��ʳ���19%��

����ǰ���ã����ݾ�������������“AI�þ�”����

������һ����ȫ������“AI�þ�”��������Ȩ������Ϊһ���߿����ĸ�磬С�������ϲ�ѯһ����У�ı�����Ϣʱ��AI���������˴������ݣ������ĵ����ر�ʾ���������⳥10��Ԫ��С���㽫��AI���з���˾�����˷�ͥ��

�������ݻ�������Ժ����������Ϊ��AI��“��ŵ”������ƽ̨����˼����ҿ������Ѳ��ÿ��еļ����ֶ����ʹ������Ѹ�֪�˷��գ��о�������������

������һ��������“AI�þ�”���������IJ�������������ý���ҵ��С�����һƪ��AI���ɵ����£����ع�˾��װ��֪����ҵ����Ҫ�ӹ�˾������ҵ��Ϊ����������ҵ�����뾺�����棬��С��������Ժ��

���������б�������Ժ�϶��������Ի�ȡ��ҵ����ΪĿ�ķ������£���֪����Դ��AI������ʧʵ��ȴû���������������ʶ�������о����淢������������Ӱ�죬���⳥3��Ԫ��

�����������������鳣��������“AI�þ�”���������ƣ�Ҳ����һ�������ռ�����������ʵΣ���������ķ�����ս�ȣ���һ�����빫����Ұ��

��������“AI�þ�”��Σ��������ռ������쵽��ʵ�������AI�Բ����õ�����Ҳ�ڹ����������ط��������ݡ�

�����ڱ�������ʦ�ƹ��ͨ��ijAI����ʱ���֣��Լ���“�ƻ���ľ”�������“��в���١�α��ӡ�¡�α�쵣����”��Υ������ŭ�У��ƹ�����ַ�����ȨΪ�ɣ���AI������˾���Ϸ�ͥ��

�����¹���“AI�þ�”��һ��Ҳ�ڽ����С�����һ�����AI���������Grok�����ϣ�ԭ��Campacte.V.Э��ָ��Grok�ڻش��û�����ʱ������������Լ��������IJ�ʵ�𰸡�

�������˱�AI“�ƻ���ľ”������Ϣ������Υ�����ӣ����˽���AI������ȴ�����˼������ƣ���������AI����Ͷ�����ƣ�����˿��𣻻����˽�AI���ɵ���ٰ���Ԯ����������……��������ż����ʡ�

�����Դˣ��й�������ѧ��ѧԺ���ڡ���Ժ�������Ϊ��“AI�þ�”�������Ϊ����“ɱ��”������ҽ�ơ����ɡ����ڵ�רҵ������û��������������Σ������������DZ�ڵ������ա�

�����ӳ�Զ������������“AI�þ�”������Ч�������������Ϊ��ٺʹ�����Ϣ���´���“���������‘AI�þ�’������ӿ�뻥���������鹹����ʷ�ȣ����ܼӾ������Ϣ������ѩ��ЧӦ��ʹ���������֪ƫ��̰�ӡ���������۸ļ��䣬����Ⱦ��һ��ģ�͵�ѵ�����ݡ�”����“AI�þ�”���а취�١����ݻ�������Ժ�羳ó��ͥͥ��Фܹ˵��

����������ײ��ϣ�ָ��һ��DZ�صĹ������⣺AI“����”����˭����

����Фܹ��Ϊ��AI���ɵIJ�ȷ��Ϣ�Ƿ���Ȩ����һ�Ŷ��ۣ��ص�Ҫ���ӵ���AI�Ŀ����ߡ�ʹ�����Ƿ���ڹ������������������������Ū���——“AI�þ�”�Ӻζ�����

����AIΪ�λ�“��˵�˵�”

����“AI�þ�”����ʱ������“��ʷ��Խ��”����ʱ�ᴴ���“ѧ������ǽ”�������ܰڳ�“�����Ի���”……��������ϸ�ھ��£����ײ���ȴ���������Ͳ�еİ߲���Ӱ��

��������“��������”��AI��Ϊ�λ�“��˵�˵�”��

���������У���λ�ܷ�ר��ָ����“AI�þ�”��������ͳ�Ƹ���������“�����²�”�����ֻþ��ĸ�Դ������AI��˼ά��ʽ��������ڱ��ʲ�ͬ��

����“Ŀǰ������ʽ�˹����ܷ����������д�����ģ�͡�”�������Ը��ܾ�������ϯ�������Ž����ڴ��´�ģ�Ϳ���������������ģ�ͱ�����һֻ“��˵��������������”�����ģ���Ԥ���˼����ʽ��һ��“�����ֽ���”��ͨ�����ı���ͼƬ��������Ϣ���б���ͼ�����Ԥ����һ����Ԫ���Ӷ��߱��ı����ɺͶԻ�������

������������������������䣬ģ�����Դ���ѵ������ĸ��ӳ���������û��廨���ŵ�����AI�����������Թ�������������ʧ������⡣

�����ƹ���������ͺܵ��͡���ϸ�˲�ƹ�����֣�“��в����”��“α��ӡ��”����ڳ������ű�������AI������������“��ʦ��ij”“���ɹ��ʻ�ij”�۸ij�����“α�쵣����”�����ݳ�����췢���İ�����AI�ֽ�������“��ijƽ”�滻���������֡�

����“����ͬΪ��ʦ��ͬ���ջƣ�AI��Ų������Ϣ������‘�ƻ���ľ’��”�ƹ��̾Ϣ������������������ÿ���˶����ܳ�ΪAI���ܺ��ߡ�

��������“AI�þ�”����һ�����أ���������ƫ���“����”AI�Ĺ����У�“Ͷι”���������ǹؼ����ڡ�AI“����”��ԭʼ���ݲ��㡢���ڴ����������ƫ���������������ɴ���Ĺ۵����ʵ��������Ϣ������

����“��AI����һ��ѧ����������Ⱦ�����ѧ�����˴���Ľ̿��飬��Ȼ�ᵼ��‘��˵�˵�’��”���ϴ�ѧ����ռ䰲ȫѧԺ�����̽���Ϊ����¶��Ŀǰ��AI��ѵ�����ݴ�����Կ�Դ���磬���������ϳ���Ŵ���δ����֤��������Դ����ģ�������“ѧϰ”һЩ������ݡ�

����ͬʱ�����в������Ӷ������“����Ͷ��”��

����ǰ���ã�����“3·15”������ع���“AIͶ��”�ĺڻ�����——����ʽ�����Ż���GEO����ҵ��ͨ��������ϵͳ�ء������Ͷ�Ŵ��������Ϣ“ι”����ģ�ͣ������ٿش�ģ������𰸣���ij��Ʒ�ơ���Ʒ����ϢԴ���������Ӱ������

�������⣬“AI�þ�”�����л���һ�����ױ����ӵ�����——�˻������Ŀ̰����ˡ��û������ʹ����У�ҲΪAI��������Ϣ�������и�Ԥ�����Ļش�

�����Ž����ͣ��ӵײ������������ģ�ͱ�ǿ��Ҫ������л�Ӧ����ѵ�����̵�ȱ�ݵ���AI�����ֺ��û�������“���Ԥ��������Ǵ��ģ�AI������Ϊ���û���������������ӭ���û���������ݣ���������ٵ���֤���ƿ�ѧ��������֧���Լ��ļ�˵��”

��������“AI�þ�”�����س�����ٻؿ��������е������������о�����俴�Ʋ�ͬ��ʵ��ΪAI�ķ����ṩ�����ݴ����봫����������ͳһ�����α߽�——ƽ̨���û���ҪΪ“AI�þ�”�е���ʶ�����ע������Ҫ���Ͼ�ʾ��ǩ��ҲҪϵ�ϰ�ȫ����

������ȫ������ôϵ��Ҳ����һ���С�Фܹ��Ϊ�����ڷ��ɽ�ֹ���ж����к���Υ����Ϣ�ȣ�ƽ̨Ҫ�Ϸ����أ����ڼ����ܷ��Ĵ�������ȥ����ͬʱ���û�ҲҪ�������飬�����Ƕ��漰���ˡ������������ʵ����Ϣ��Ҫ��������Χ�ں�ʵ�����

�����˻��������������Ʒ���

�������ڵ�ǰ�ļ���������ר���ձ���Ϊ��“AI�þ�”�����������������Ƕ��������ķ����뾯�ѣ���ʹ���ǻش�һ������——�������Ӧ����Ϣ�����ٶ�Զ����֤������ʱ����

�������㷨���������ر�֯���ԣ��ƽ�֮�������������������ļ��������ǹ�����һ����֮ƥ���������̬��������ϵ���������ߣ��γɷ��տɿص��˻�Эͬ���ơ�

������һ����AI���ս�����Ч�����ݣ��������õ�������̬��

���������Ż��ǻ���“AI�þ�”��Դͷ��Ŀǰ��AI��������Ͽ�����ҵ�Խ�����Ϊ����������Դ����ƫ�ã�������ݬ���롣

������λ�ܷ�ר�ҽ��飬�ڱ���������˽����Ϣ��ȫ��ǰ���£�Ӧ���������������Эͬ���ƣ�ʵ�ֻ�����Ϣ�������������ݡ�ѧ���������ݵ����ݹ�����̽������Ȩ���ԵĹ�������ƽ̨�����ٵ�һ��Դ��ʧ�����⡣ͬʱ��AI��������������ѵ��������������ѵ�����ݽ�����ϴ����֤��ȷ��ѵ�����ݵ�ȷ�ԺͿɿ��ԡ�

�������㽭�����ݹ������Ͽ����ӿ콨�貽������Ŀ�ľ���Ϊ��ģ��ѵ���ṩ��ȡ������������ģ�����ͳɱ���������Դ������ȫ���������Ҳ�ѷ������߱���ҵ�㷺Ӱ������AI���Ͽ⣬����ͨ�á�ҽ�ơ������ԡ�����ȶ������������

�����������ǿ��֤��˲飬�������Ӷ�ά���ɿ��İ�ȫǽ��

����“�Լ��μ�”�ǽ��“AI�þ�”�������ѡ·���������У����߷��֣���������˹����ܳ����Ѳ�ȡ���ַ��δ�ʩ����ͼ���ͻþ������У�ʹ�ü�����ǿ��RAG��������Ϊ���ٳ��̵�ѡ��֮һ��“���൱�����õ�֪ʶ�⣬�ܴӴ����ⲿ���ݿ��м��������Ϣ���������Щ��Ϣ�������ɣ�������ݵ�ȷ�ԡ�”�Ž����ܡ�

��������������ѧ���·�ѧԺ�����ڷ���ӱ�����о����ݷ��Ρ������飬ƽ̨Ӧ������ϸ����������ϵ����������Ѷ��������Ϣ����ͨ��Ϣ���ʵ���������̣������漰Υ������ȿ���Ӱ�칫��������������Ϣ������ʹ��Ȩ�����ݿ⣬����ж��ؽ�����Դ��֤��

�����ڼ�ܲ��棬Фܹ���飬����AIƽ̨����ǰ������������ԵĶԿ���ѵ���ȼ�⣬���趨�����ҵ����ϸ������ѵ�����ݡ�������ʩ��Ҫ��

�������������������Ӧ�õļ�ֵ����

�������“AI�þ�”���������塢���ɳ����������������ڽ�����ȷ�ļ�����ֵ�ۡ�

������ʡ���Ժ��ѧ�����������濴�����㷨Ȩ�ѳ�Ϊһ���������Ȩ�����AIƽ̨�ڿ��������о����Ӧ��������������δ��¡��ɿ��Ե�������ֵ���빤��ʦ��ͷ�ԡ�ֲ���ģ�͵Ĵ��롣

�������磬��������������۲����ɡ�����Դ����Ϣ�����ɡ�����ģ����֪�߽�����ݲ����ɵ�ԭ���ƶ���ģ�ʹ���������������ȷ�����ݿɿ���ת�ͣ������ּ�������ʾ�ƶȣ����ո߿��š����ʵ���Ʋ��Խ��۵ȣ����з����ע����ǿ������ݵ����ȡ�

������ע����һ��AI�������ʱ����“AI�þ�”������֮·����Ҫ�����ĵ�����̽����Ҳ������AI��ι���������Эͬ��һ�����С�

���������λ�ܷ�ר����˵����ԦAI�Ĺؼ���������AI“��������”����������������ж�����Ψ�г���ǿ�������з�����ȫ�淶��ϵ������У����ƣ����ܶ��ƻþ����գ��ƶ��Ƽ����ơ�

�༭�� �������171964650@qq.com

�й��������ֻ���

�Ź��ں�